AutoInputFormat.classDumpTypedBytes.classEnvironment.classHadoopSteaming.classETC.

”jar 2.8.0 hadoop streaming“ 的搜索结果

参考: http://hadoop.apache.org/docs/r2.6.0/hadoop-mapreduce-client/hadoop-mapreduce-client-core/HadoopStreaming.html

hadoop streaming 就是使用 hadoop jar 调用streaming jar包进行MR. 通过标准输入和标准输出进行交互. 脚本语言如python会从标准输入中读, 向标准输入中写.hadoop jar 命令有两种类型的参数, generic options 和 ...

org.apache.flink.core.fs.UnsupportedFileSystemSchemeException: Could ... The scheme is not directly supported by Flink and no Hadoop file system to support this scheme could be loaded. For a full list of

转载于:https://blog.csdn.net/pucao_cug/article/details/72083172 写的很赞~1下载Sqoop2上载和解压缩3一系列配置 3.1配置环境变量 3.2sqoop配置文件修改 3.2.1 sqoop-env.sh文件 3...

先去官网下载hadoop2.8.0源码并解压,打开解压目录下的BUILDING.txt,编译过程和需要的软件其实就是根据这个文档里的描述来的。 (可以通过命令下载:wget ...

注意:本文只讲Sqoop1.4.6的安装。...本例安装sqoop的机器上已经安装了hdoop2.8.0和hive2.1.1,hadoop2.8.0的安装请参考博文: http://blog.csdn.net/pucao_cug/article/details/71698903 hive2.1.1的安装请参...

Hadoop实现了一个分布式文件系统,简称HDFS。HDFS有高容错性的特点,并且设计用来部署在低廉的硬件上;而且它提供高吞吐量来访问应用程序的数据,适合那些有着超大数据集的应用程序。HDFS放宽了POSIX的要求,可以以...

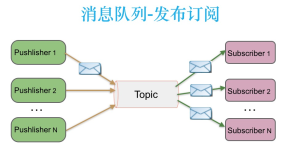

文档基于介绍基于Hadoop的大数据生态圈。介绍下图每一个组件的使用场景及使用方法,同时还对每一个组件有更深入的介绍。 ...

第一步:JDK环境准备 特别说明一下:官网要求Flink编译和使用的时候JDK版本必须是1.8以上,所以这里我们使用的额是1.8.0.221版本,建议大家JDK用1.8.0.191或者1.8.0.221以上的版本。不要用低于1.8.0.191的版本,...

hdfs要小写 hadoop102是集群namenode的节点ip al backend: StateBackend = new RocksDBStateBackend...C:\Java\jdk1.8.0_45\bin\java.exe “-javaagent:G:\soft\IntelliJ IDEA 2019.3.1\lib\idea_rt.jar=61507:G:\sof

1.启动Spark Shellspark-shell是Spark自带的交互式Shell程序,方便用户进行交互式编程,用户可以在该命令行下用scala编写spark程序。要注意的是要启动Spark-Shell需要先启动Spark-ha集群,Spark集群安装和部署参考:...

一、Flink Window窗口机制:时间窗口TimeWindow:会话窗口(Session Window) ### --- Flink Window窗口机制:时间窗口TimeWindow:会话窗口(Session Window) ~~~ 时间窗口TimeWindow:会话窗口(Session Window) ...

一、Flink kafka Producer ### --- 代码执行流程 ~~~ nc ~~~ 代码接受nc ~~~ 把接收到的nc的数据,给到kafka flink kafka producer 二、编程代码 ### --- 编程代码 ...import org.apache.flink....

Linux上安装Hadoop集群(CentOS7+hadoop-2.8.0) https://blog.csdn.net/pucao_cug/article/details/71698903 本地主机如何访问虚拟机centos的web服务器、关闭防火墙 ...

一、DataStream常用API:Sink ### --- Sink ~~~ # Flink针对DataStream提供了大量的已经实现的数据目的地(Sink),具体如下所示 ~~~ writeAsText():讲元素以字符串形式逐行写入,这些字符串通过调用每个元素的...

一、Flink常用API详解 ### --- Flink常用API详解 ~~~ DataStream API主要分为3块:DataSource、Transformation、Sink ~~~ DataSource是程序的数据源输入, ~~~ 可以通过StreamExecutionEnvironment.addSource...

一、[方法一:没有并行度数据源]:编程代码实现:没有并行度数据源 ### --- 自定义数据源:没有并行度数据源:为非并行源implements ...import org.apache.flink.streaming.api.functions.source.SourceFuncti...

一、Flink DataStream常用API:Transformation ### --- 编程实现:ConnectDemo.java package com.yanqi.streamtransformation; import com.yanqi.streamdatasource.SelfSourceParallel; import ...

一、Flink Window窗口机制:时间窗口(TimeWindow) ### --- 滚动时间窗口(T目标领Window)基于事件驱动 ~~~ # 场景: ~~~ 当我们想要每100个用户的购买行为作为驱动,那么每当窗口中填满100个”相同”元素了, ...

一、Flink Window窗口机制 ### --- 时间窗口TumWindow:基于时间驱动 ~~~ # 场景: ~~~ 我们需要统计每一分钟中用户购买的商品的总数,需要将用户的行为事件按每一分钟进行切分, ~~~ 这种切分被成为翻滚时间...

近来学习Spark,作为Linux小白,在Hadoop与Spark平台搭建过程中,产生了许多之前未预料的错误。经过锲而不舍的网上查找文章和不断尝试,终于解决了所有的错误,成功将Spark平台运行起来。为了防止今后的遗忘,也为了...

推荐文章

- YOLO V8车辆行人识别_yolov8 无法识别路边行人-程序员宅基地

- jpa mysql分页_Spring Boot之JPA分页-程序员宅基地

- win10打印图片中间空白以及选择打印机预览重启_win10更新后打印图片中间空白-程序员宅基地

- 【加密】SHA256加盐加密_sha256随机盐加密-程序员宅基地

- cordys 启动流程_cordys服务重启-程序员宅基地

- net中 DLL、GAC-程序员宅基地

- (一看就会)Visual Studio设置字体大小_visual studio怎么调整字体大小-程序员宅基地

- Linux中如何读写硬盘(或Virtual Disk)上指定物理扇区_dd写入确定扇区-程序员宅基地

- python【力扣LeetCode算法题库】面试题 17.16- 按摩师(DP)_一个有名的讲师,预约一小时为单位,每次预约服务之间要有休息时间,给定一个预约请-程序员宅基地

- 进制的转换技巧_10111100b转换为十进制-程序员宅基地